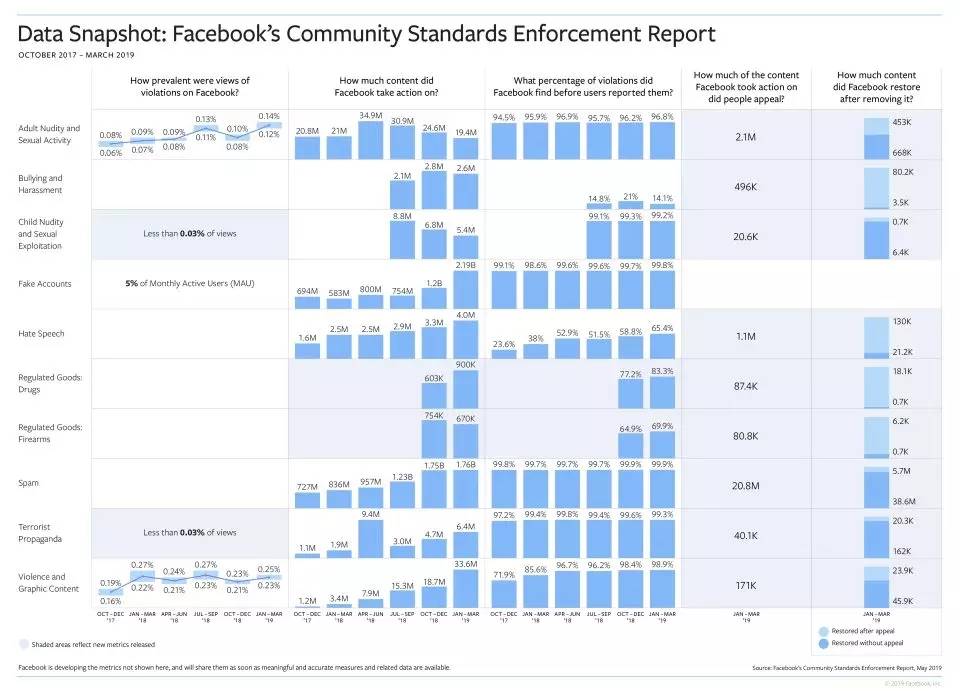

Facebook发布了第三份社区准则执行报告,涵盖了2018年第四季度和2019年第一季度的情况。

总的来说,Facebook现在执行九项政策指标,成人裸体和性活动、欺凌和骚扰、儿童裸体和对儿童的性剥削、虚假账户、仇恨言论、受管制商品、垃圾邮件、恐怖主义内容。

估计Facebook上每10000次访问量就会有11到14次浏览的内容违反了成人裸体和性活动准则。

每10000次Facebook访问量中包括25次浏览的内容违反了暴力和图形内容政策。

估计每月有5%的活跃账户是虚假账户。

当然,Facebook也采取了一些行动,因为这些浏览违反了社区准则。操作包括删除内容、发出警告或禁用账户。

还有一些指标反应了违反Facebook政策内容的数量,以及如何识别:

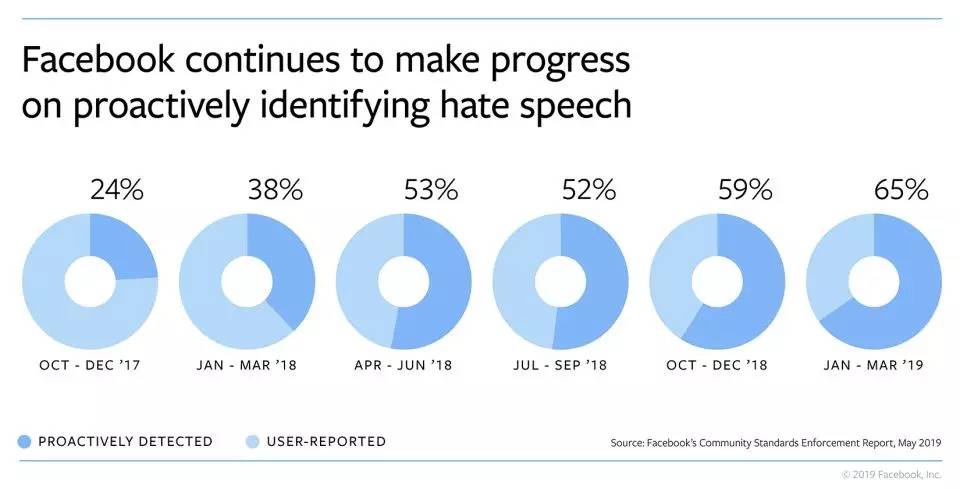

主动率:在Facebook采取行动的内容中,有些是在有人报告之前就被系统检测到了。这项指标反映AI在特定准则领域的有效性。

根据Facebook的数据,其主动率为95%以上。对于仇恨言论,检测到删除内容的65%,高于一年前(24%)。2019年第一季度Facebook共删除了400万条仇恨言论。

2018年夏天,Facebook开始尝试使用人工智能来识别违反监管商品准则的内容。2019年第一季度Facebook对大约90万件药品销售内容采取了行动,其中83.3%是主动发现的。同时,对67万件枪支销售内容采取了行动,主动率为69.9%。